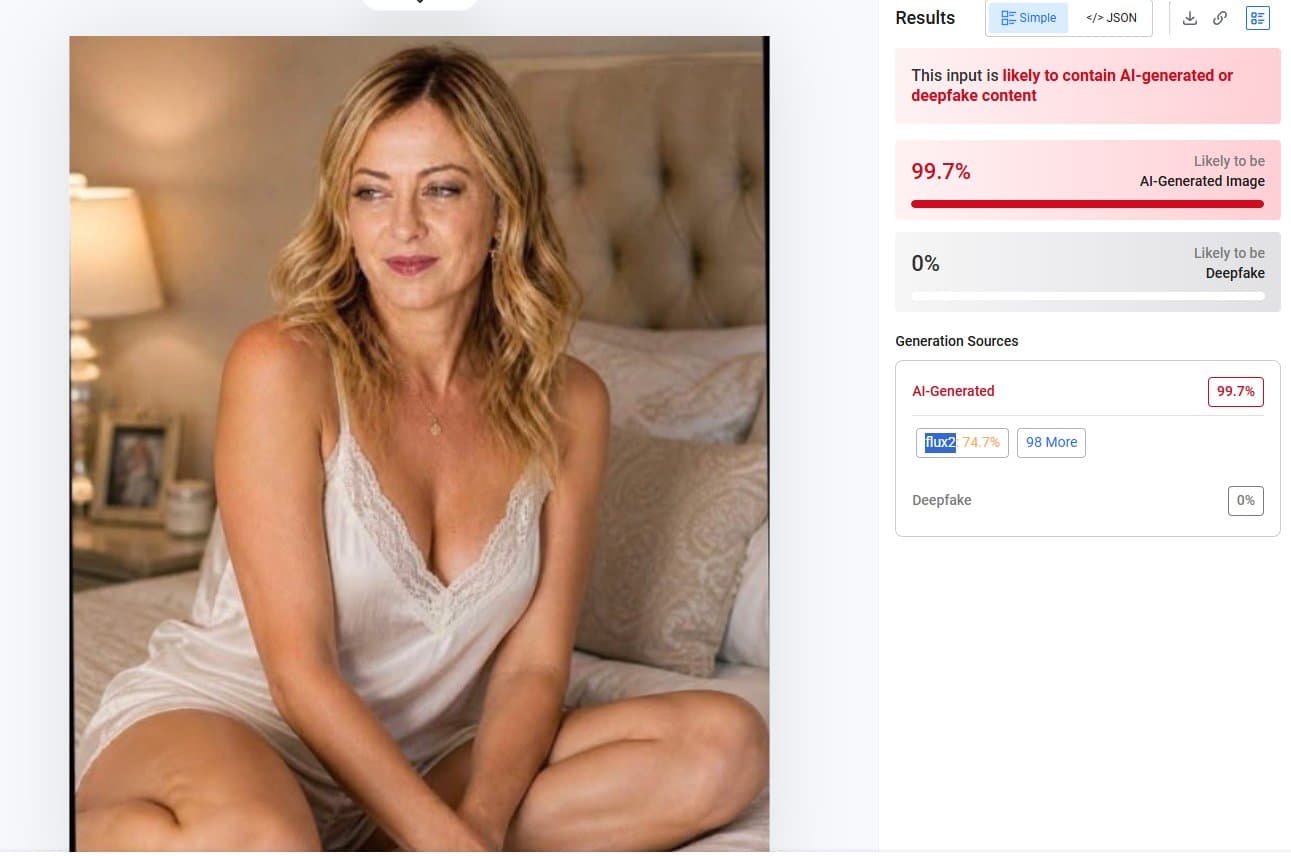

وجدت رئيسة الوزراء الإيطالية جورجيا ميلوني نفسها في قلب عاصفة رقمية بعد انتشار صور إباحية ومثيرة نُسبت إليها على نطاق واسع عبر منصات التواصل الاجتماعي، منها صور بقميص النوم يتم تداولها على نطاق واسع.

القضية لم تبق محصورة في إطار فضيحة رقمية عابرة أو هجوم شخصي على سياسية معروفة، بل تحولت بسرعة إلى نقاش أوروبي واسع حول مستقبل الحقيقة في عصر أصبح فيه الذكاء الاصطناعي قادرًا على تصنيع صور وفيديوهات شديدة الواقعية يمكنها خداع ملايين المستخدمين خلال ساعات قليلة فقط، وهو ما دفع ميلوني نفسها إلى التدخل علنًا والتعليق على الصور المتداولة بطريقة جمعت بين السخرية والتحذير في آن واحد.

كيف بدأت قصة الصور المزيفة؟

بدأت القصة بعد تداول صور تظهر رئيسة الوزراء الإيطالية بملابس داخلية وفي أوضاع حميمية، بينما تعاملت بعض الحسابات السياسية والصفحات المعارضة مع الصور وكأنها حقيقية، الأمر الذي ساهم في انتشارها بسرعة كبيرة عبر منصة X وفيسبوك وتيك توك ومجموعات الدردشة المغلقة.

الصور بدت واقعية بدرجة كافية لخداع عدد كبير من المستخدمين الذين أعادوا نشرها دون التحقق من مصدرها أو حقيقتها، خصوصًا مع التطور الكبير الذي شهدته أدوات الذكاء الاصطناعي خلال العامين الأخيرين، حيث أصبحت قادرة على إنتاج صور يصعب على المستخدم العادي التمييز بينها وبين الصور الحقيقية.

ومع اتساع الجدل، بدأت وسائل إعلام إيطالية وأوروبية تتحدث عن القضية بوصفها واحدة من أبرز الأمثلة الحديثة على خطورة تقنيات الـDeepfake في المجال السياسي والإعلامي.

رد جورجيا ميلوني: سخرية وتحذير

رئيسة الوزراء الإيطالية خرجت عن صمتها عبر منشور علني أكدت فيه أن الصور المنتشرة مزيفة بالكامل وأنها صُنعت باستخدام الذكاء الاصطناعي، معتبرة أن بعض خصومها السياسيين المتحمسين يساهمون في نشرها وتقديمها على أنها حقيقية.

لكن اللافت أن ميلوني اختارت الرد بنبرة ساخرة نسبيًا في البداية، إذ قالت إن الشخص الذي قام بإنشاء تلك الصور “حسّن مظهرها بشكل كبير”، في تعليق أثار تفاعلًا واسعًا على الإنترنت بسبب طريقته الساخرة في التعامل مع القضية.

بعد ذلك انتقلت ميلوني إلى الحديث بجدية أكبر عن خطورة ما يحدث، مؤكدة أن القضية لم تعد تتعلق بها شخصيًا بقدر ما أصبحت تعكس تهديدًا متزايدًا يمكن أن يطال أي إنسان في العالم الرقمي الجديد، خصوصًا مع سهولة إنتاج هذا النوع من المحتوى وانتشاره بسرعة هائلة.

“ما يحدث لي اليوم قد يحدث لأي شخص غدًا”

في رسالتها التحذيرية، شددت ميلوني على أن تقنيات التزييف العميق أصبحت أداة خطيرة قادرة على الخداع والتلاعب والتضليل، مشيرة إلى أنها تملك الإمكانيات السياسية والإعلامية للدفاع عن نفسها، بينما قد لا يمتلك كثيرون آخرون القدرة ذاتها إذا تعرضوا لحملات مشابهة.

كما دعت المستخدمين إلى التحقق من المحتوى قبل تصديقه أو إعادة نشره، في رسالة بدت وكأنها اعتراف ضمني بأن الإنترنت دخل مرحلة لم تعد فيها الصورة أو حتى الفيديو دليلًا كافيًا على الحقيقة.

تصريحات ميلوني لاقت اهتمامًا واسعًا في الإعلام الأوروبي، لأن القضية تجاوزت مجرد استهداف شخصية سياسية معروفة، وأصبحت مرتبطة بسؤال أكبر يتعلق بمستقبل الثقة في المحتوى الرقمي.

كيف تعمل تقنية الـDeepfake؟

يشير خبراء التكنولوجيا إلى أن ما تعرضت له ميلوني يمثل مثالًا واضحًا على الطفرة الخطيرة التي شهدتها تقنيات الـDeepfake خلال السنوات الأخيرة، إذ تعتمد هذه الأنظمة على نماذج ذكاء اصطناعي متطورة قادرة على تحليل آلاف الصور ومقاطع الفيديو الحقيقية لأي شخص، ثم إعادة تركيب وجهه وتعابيره داخل مشاهد جديدة تبدو واقعية للغاية.

وخلال عامي 2025 و2026 تحديدًا، شهدت أدوات توليد الصور والفيديوهات قفزة ضخمة من حيث الجودة والواقعية، حتى أصبحت بعض الصور المولدة بالذكاء الاصطناعي قادرة على خداع المستخدمين وحتى بعض أنظمة التحقق البسيطة.

هذا التطور جعل خبراء الأمن الرقمي يحذرون من أن التزييف العميق قد يتحول خلال السنوات المقبلة إلى واحدة من أخطر أدوات التضليل الإعلامي والسياسي في العالم.

من الابتزاز إلى الحروب السياسية

يحذر مختصون من أن هذا النوع من المحتوى لم يعد مجرد وسيلة للترفيه أو المزاح على الإنترنت، بل تحول تدريجيًا إلى أداة تستخدم في التشهير السياسي والابتزاز والانتقام الرقمي والتأثير على الرأي العام، خاصة في الفترات الانتخابية أو في البيئات السياسية شديدة الاستقطاب.

ولهذا السبب يرى كثير من المراقبين أن استهداف رئيسة وزراء دولة أوروبية عبر صور إباحية مزيفة ليس حادثًا هامشيًا، بل مؤشر على شكل جديد من الحروب الإعلامية التي يمكن أن تعتمد مستقبلًا على الذكاء الاصطناعي بدل التسريبات التقليدية أو الحملات الدعائية القديمة.

كما يخشى خبراء من أن الاستخدام الواسع لهذه الأدوات قد يؤدي تدريجيًا إلى انهيار الثقة العامة في الصور والفيديوهات نفسها، بحيث يصبح من السهل التشكيك في أي محتوى حقيقي أو تبرير أي فضيحة باعتبارها “مصنوعة بالذكاء الاصطناعي”.

النساء ما زلن الهدف الأسهل

أعادت قضية ميلوني تسليط الضوء على حقيقة أن النساء ما زلن الفئة الأكثر تعرضًا لهذا النوع من الهجمات الرقمية، إذ تشير تقارير تقنية وحقوقية إلى أن الغالبية الساحقة من محتوى الـDeepfake الإباحي يستهدف النساء، سواء كن سياسيات أو صحفيات أو ممثلات أو مؤثرات على مواقع التواصل الاجتماعي.

ويعتبر كثير من الباحثين أن هذه الظاهرة تمثل شكلًا جديدًا من العنف الرقمي، لأن الضحية تجد نفسها أمام صور أو فيديوهات تبدو حقيقية تمامًا رغم أنها لم تُلتقط أصلًا في الواقع، بينما يكون انتشارها أسرع بكثير من قدرة الضحية على احتواء الضرر.

كما يرى مختصون أن التأثير النفسي والاجتماعي لمثل هذه الحملات قد يكون مدمرًا، خصوصًا عندما يتعلق الأمر بشخصيات عامة تتعرض أصلًا لمراقبة إعلامية وضغط جماهيري دائم.

أوروبا تتحرك لتنظيم الذكاء الاصطناعي

تأتي هذه القضية بينما تشهد أوروبا نقاشًا متزايدًا حول ضرورة فرض قوانين أكثر صرامة على استخدامات الذكاء الاصطناعي، خاصة بعد تصاعد المخاوف من إمكانية استخدامه في التلاعب السياسي ونشر الأخبار الكاذبة والتأثير على الانتخابات وصناعة حملات تشويه يصعب احتواؤها بعد انتشارها.

وكانت إيطاليا من أوائل الدول الأوروبية التي أبدت قلقًا واضحًا تجاه بعض تطبيقات الذكاء الاصطناعي، بل إنها سبق أن فرضت قيودًا مؤقتة على بعض الخدمات المرتبطة به بسبب مخاوف تتعلق بالخصوصية والأمن الرقمي.

ويرى مراقبون أن فضيحة الصور المزيفة لميلوني قد تزيد الضغط داخل الاتحاد الأوروبي لتشديد القوانين المتعلقة بالـDeepfake ومحاسبة من يستخدمون هذه الأدوات في التشهير والتضليل.